Qu’est-ce que l’IA dans SOLIDWORKS ?

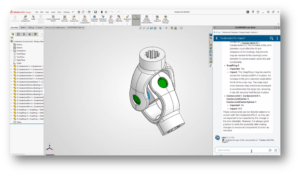

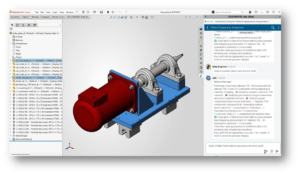

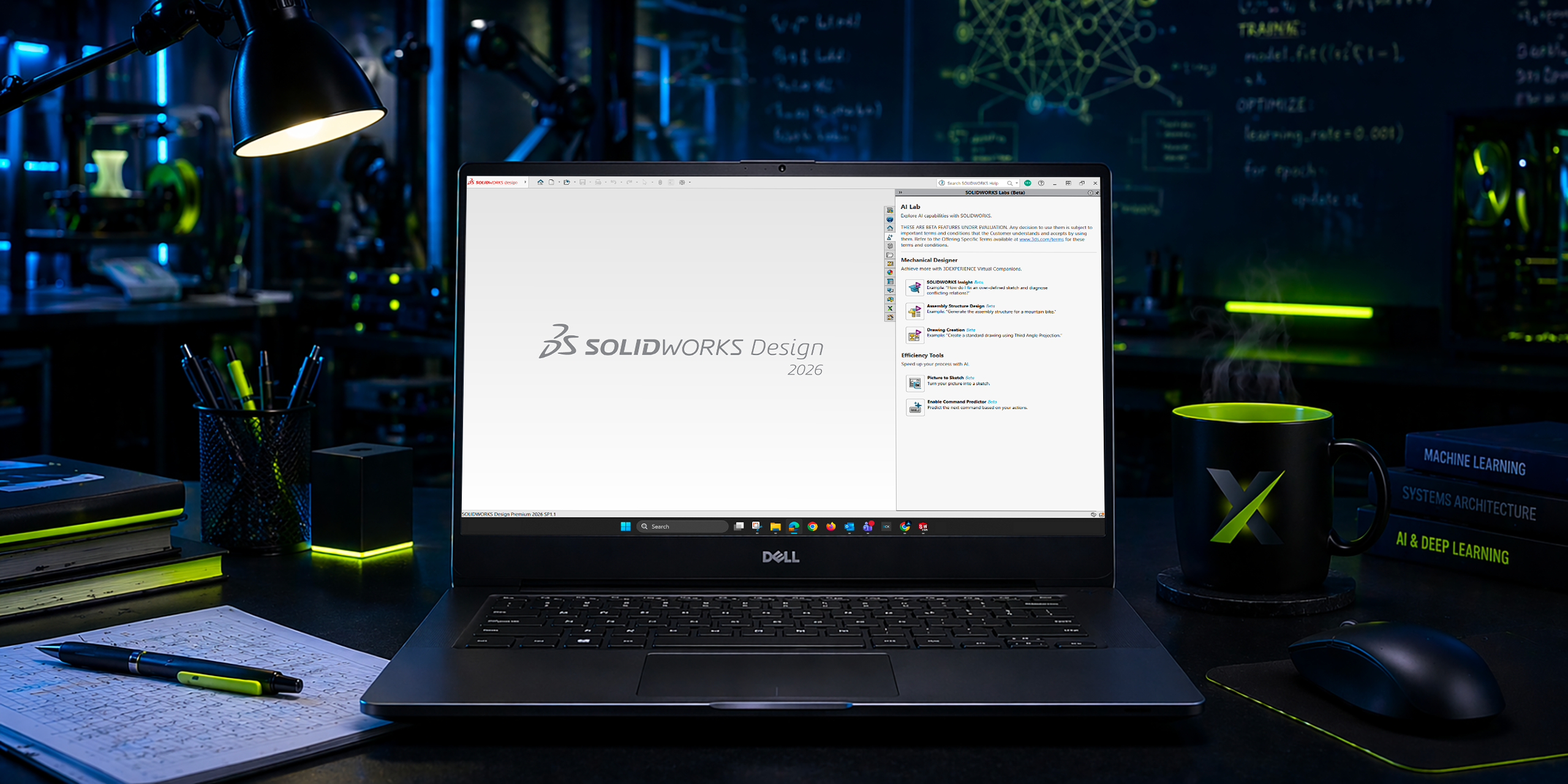

Essentiellement, SOLIDWORKS AI désigne un ensemble de fonctionnalités intelligentes qui assistent les ingénieurs en automatisant les tâches répétitives, en fournissant des conseils de conception et en permettant une orchestration au niveau des flux de travail, grâce à des fonctionnalités intégrées ainsi qu’à des Compagnons Virtuels avec lesquels vous pouvez interagir en langage naturel.

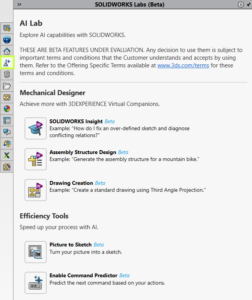

Quelles fonctionnalités d’IA sont actuellement disponibles dans SOLIDWORKS ?

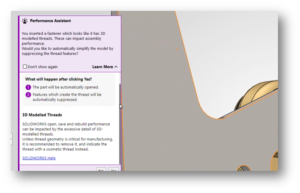

À l’heure actuelle, les fonctionnalités actuelles comprennent la génération automatisée de mises en plan, l’assistance générale à la conception via un chat interactif, le prédicteur de commandes, l’analyse et la réparation d’esquisses, la reconnaissance de fixations, et bien d’autres fonctionnalités en cours de développement rapide.

-

En savoir plus sur ce qui est disponible dans SOLIDWORKS AI

-

Restez à jour avec les dernières fonctionnalités de SOLIDWORKS Design

Quelle est la différence entre les fonctionnalités d’IA intégrées et les Compagnons Virtuels dans SOLIDWORKS ?

D’une part, l’IA intégrée désigne les fonctionnalités et capacités basées sur l’apprentissage automatique qui améliorent les flux de travail de conception actuels. À l’inverse, les Compagnons Virtuels sont des assistants IA que l’on peut solliciter en langage naturel pour accéder à des connaissances et effectuer des tâches spécifiques. Ces deux approches sont disponibles directement dans l’interface utilisateur de SOLIDWORKS Design.

Quels sont les rôles respectifs des nouveaux compagnons virtuels ?

Contrairement aux agents conversationnels génériques, nos compagnons incarnent l’IA « au cœur » de l’ingénierie, fondée sur la physique et la causalité.

|

Nom |

Spécialité |

Ex. d’application (Aile d’un E-foil) |

|---|---|---|

|

AURA |

Connaissances et contexte |

Équilibre les exigences de force, de légèreté et de résistance à l’eau (ex: choix entre fibre de carbone et fibre de verre). |

|

LEO |

Raisonnement technique |

Optimise le ratio résistance/poids via des composites en carbone, spécifiquement les drapés unidirectionnels avec résine époxy pour la rigidité et la fatigue. |

|

MARIE |

Science des matériaux |

Analyse les facteurs critiques comme la densité (1,6 g/cm³), le module d’élasticité et la résistance à la dégradation induite par l’eau. |

Comment ces entités collaborent-elles pour optimiser un projet ?

En effet, l’innovation naît souvent de la confrontation des points de vue. AURA explore le champ des possibles, tandis que MARIE ancre le projet dans la science rigoureuse des matériaux, alors que LEO assure la faisabilité mécanique et industrielle.

Pourquoi le passage au Cloud est-il incontournable pour ces nouvelles IA ?

En pratique, l’extraction de connaissances, le minage profond de données (deep data mining) et l’exécution de modèles d’IA complexes nécessitent une puissance de calcul massive. L’infrastructure Cloud est la seule capable de fournir ces ressources de manière flexible et économiquement viable pour toutes les entreprises.

SOLIDWORKS AI utilise-t-il les données des clients pour l’entraînement ?

Non. En effet, les données des clients ne sont pas utilisées pour entraîner les modèles d’IA. Des contrôles de gouvernance assurent la protection de la propriété intellectuelle. Vous pouvez en savoir plus en visitant le Centre de confiance 3DS.

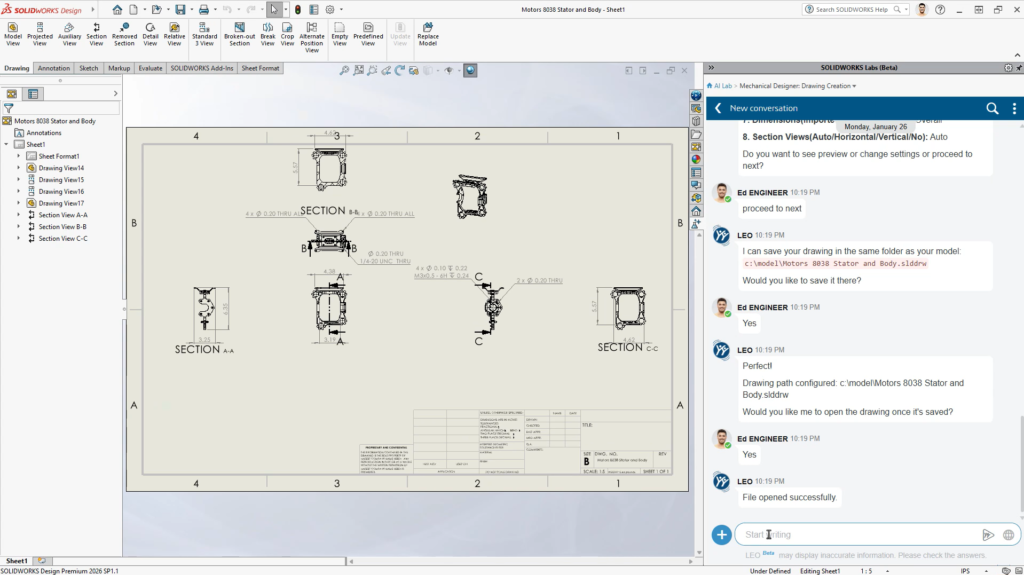

Est-ce que l’IA crée t-elle automatiquement des mises en plan ?

Oui, SOLIDWORKS Design inclut la possibilité de générer automatiquement des mises en plan 2D en sollicitant les Compagnons Virtuels en langage naturel. De plus, elles peuvent être générées selon des normes, des modèles et des schémas de cotation spécifiés, accélérant ainsi le processus de documentation.

Quelles tâches CAO répétitives l’IA peut-elle automatiser ?

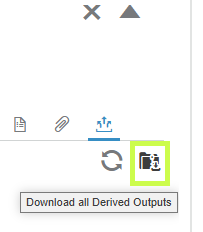

Par exemple, SOLIDWORKS AI automatise les tâches d’ingénierie répétitives telles que la création de mises en plan et la génération de structures d’assemblage. Des fonctionnalités supplémentaires seront incluses dans les versions futures.

Comment SOLIDWORKS AI protège-t-il la propriété intellectuelle ?

Par ailleurs, SOLIDWORKS AI garantit que la propriété intellectuelle des clients reste isolée et sécurisée. Apprenez-en davantage sur les protocoles de sécurité spécifiques en visitant le Centre de confiance 3DS.

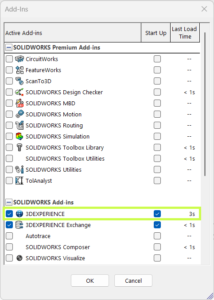

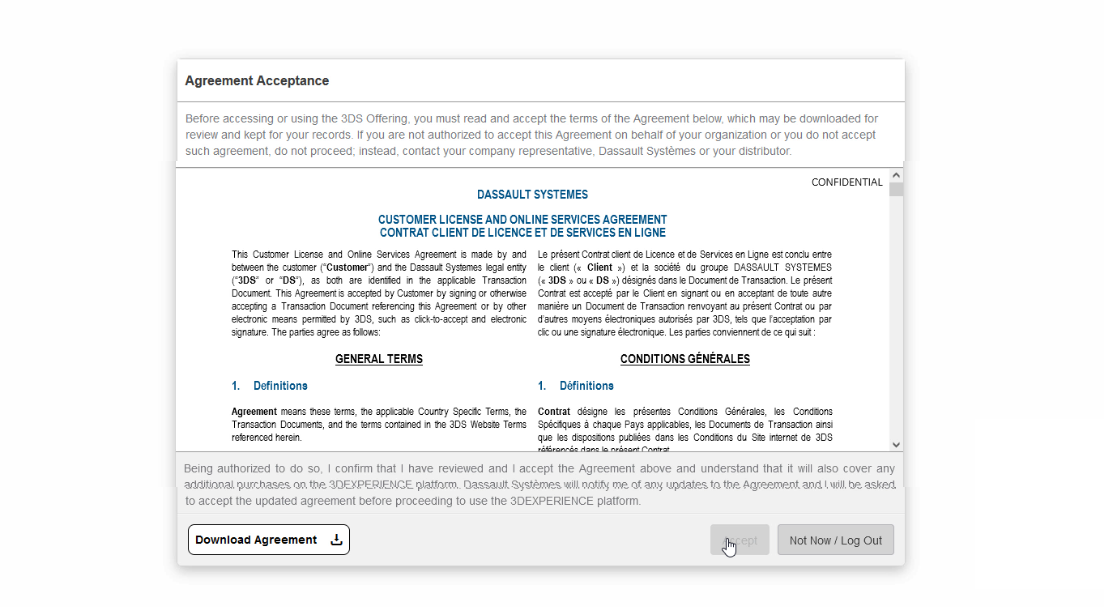

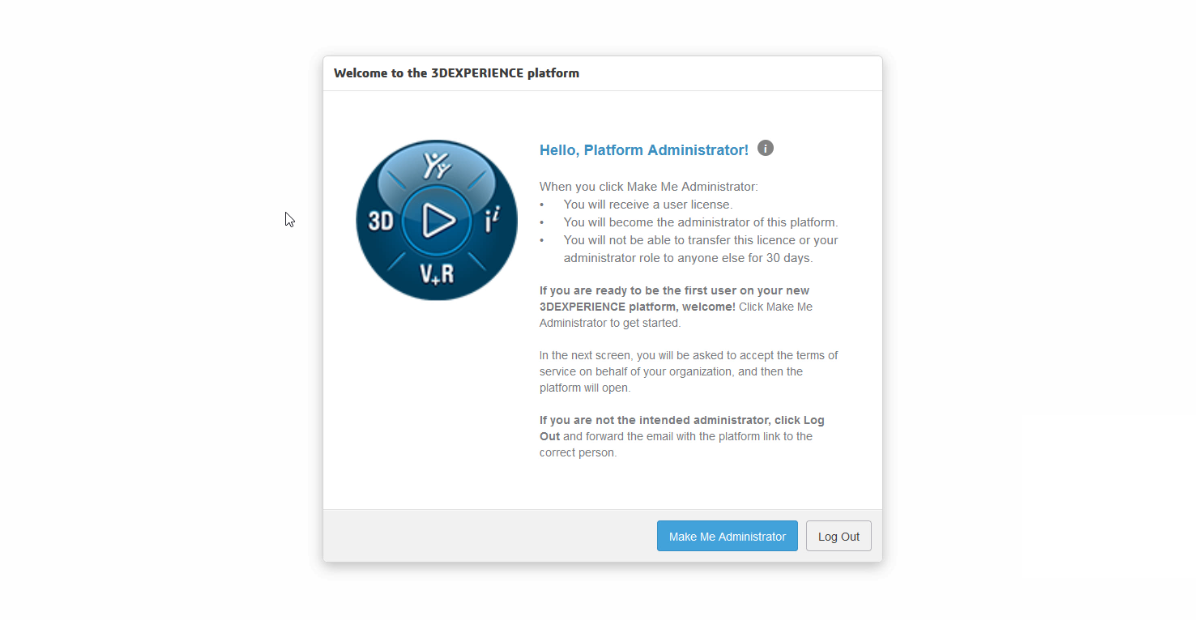

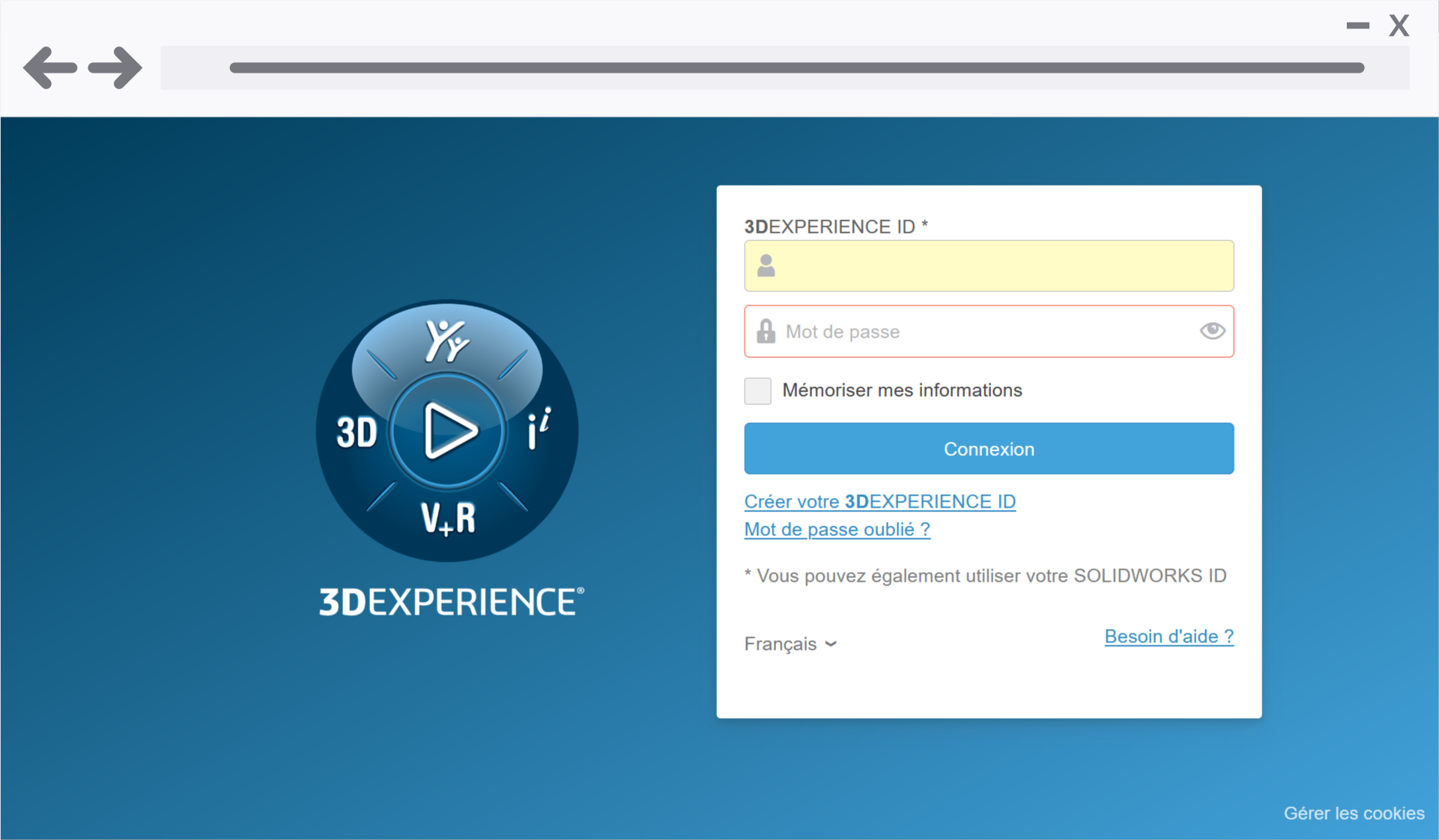

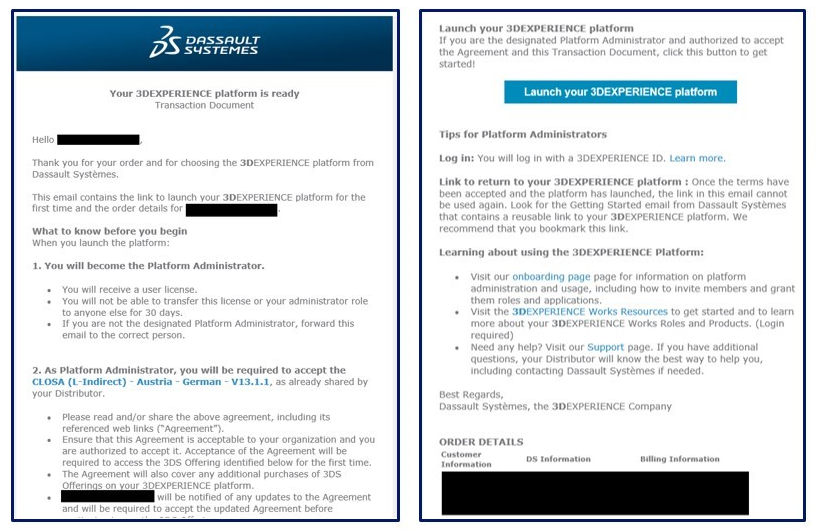

Comment puis-je commencer à utiliser l’IA dans SOLIDWORKS ?

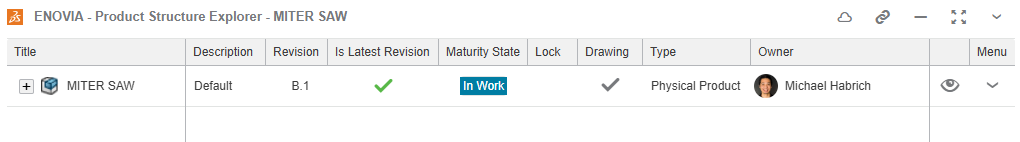

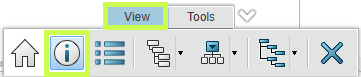

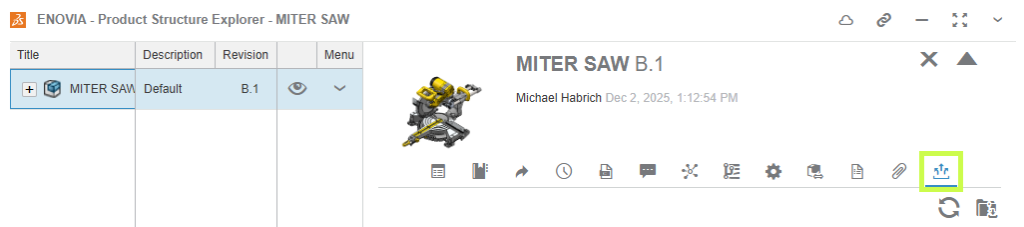

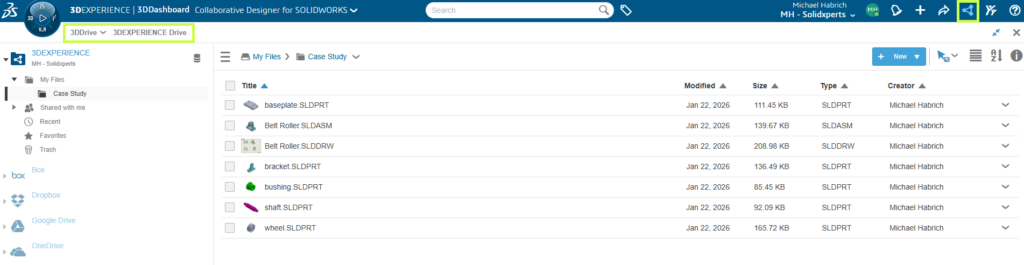

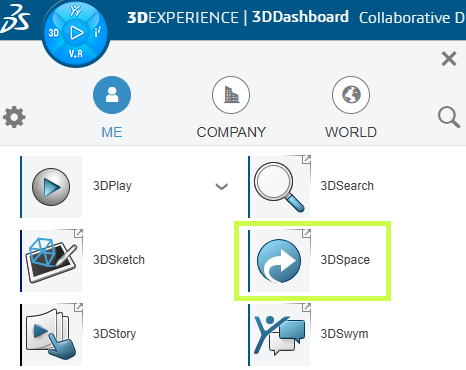

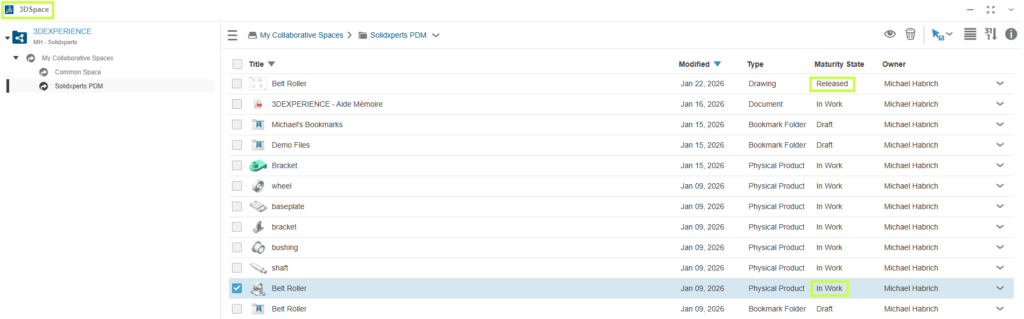

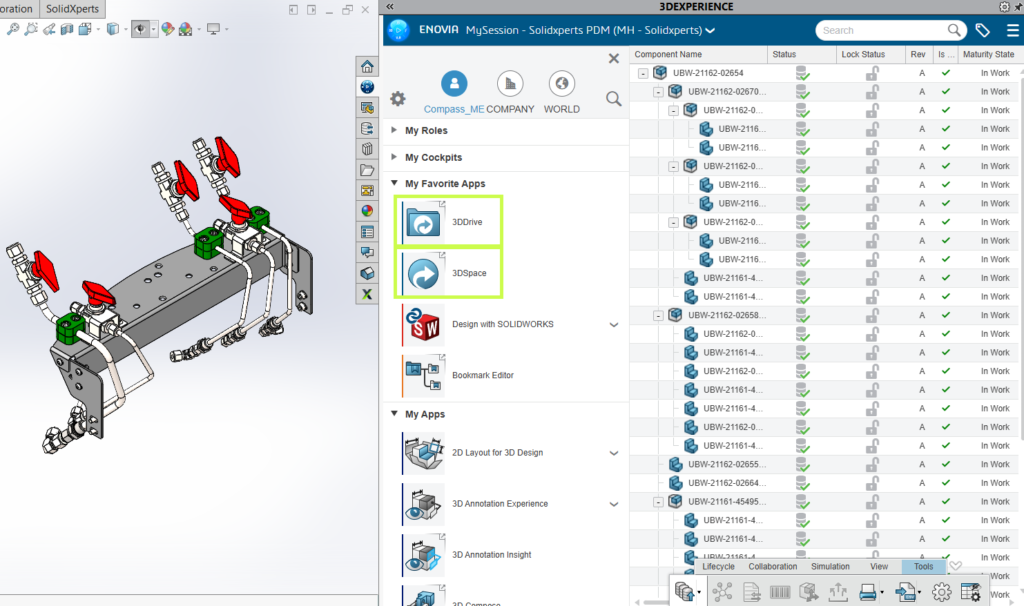

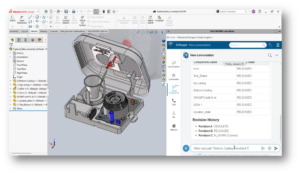

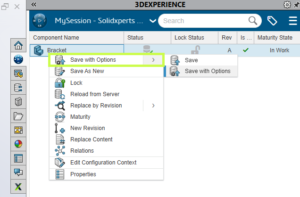

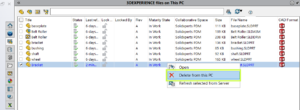

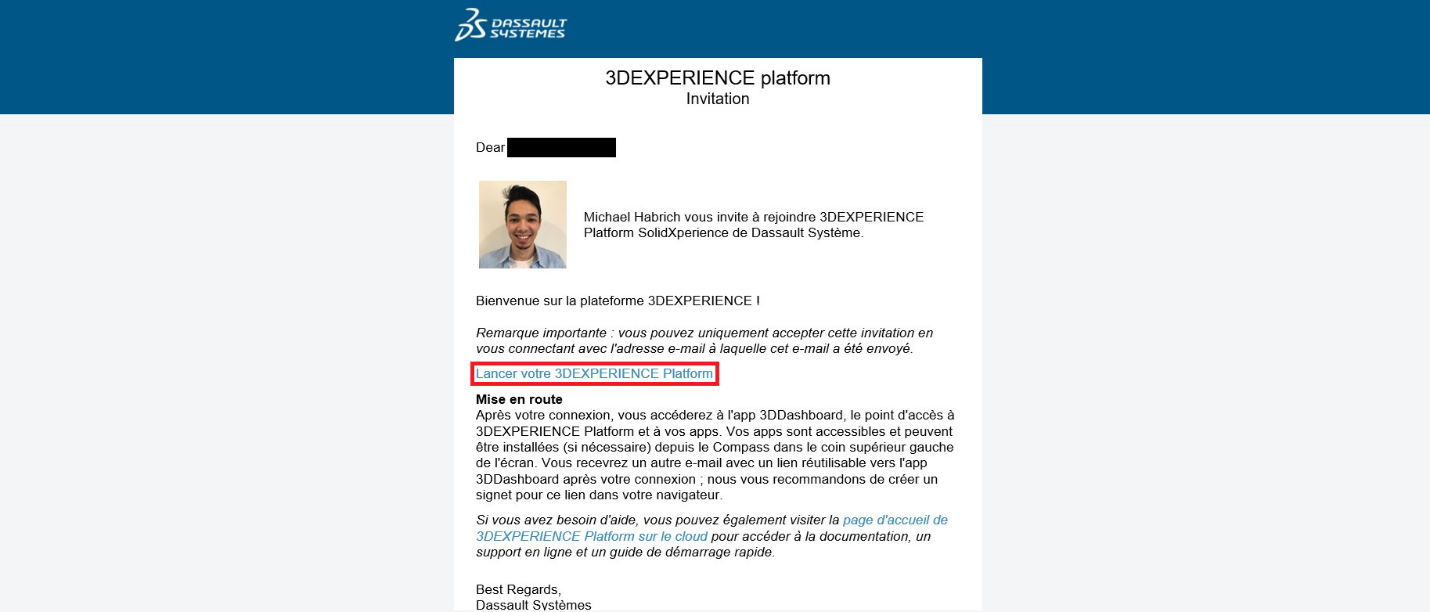

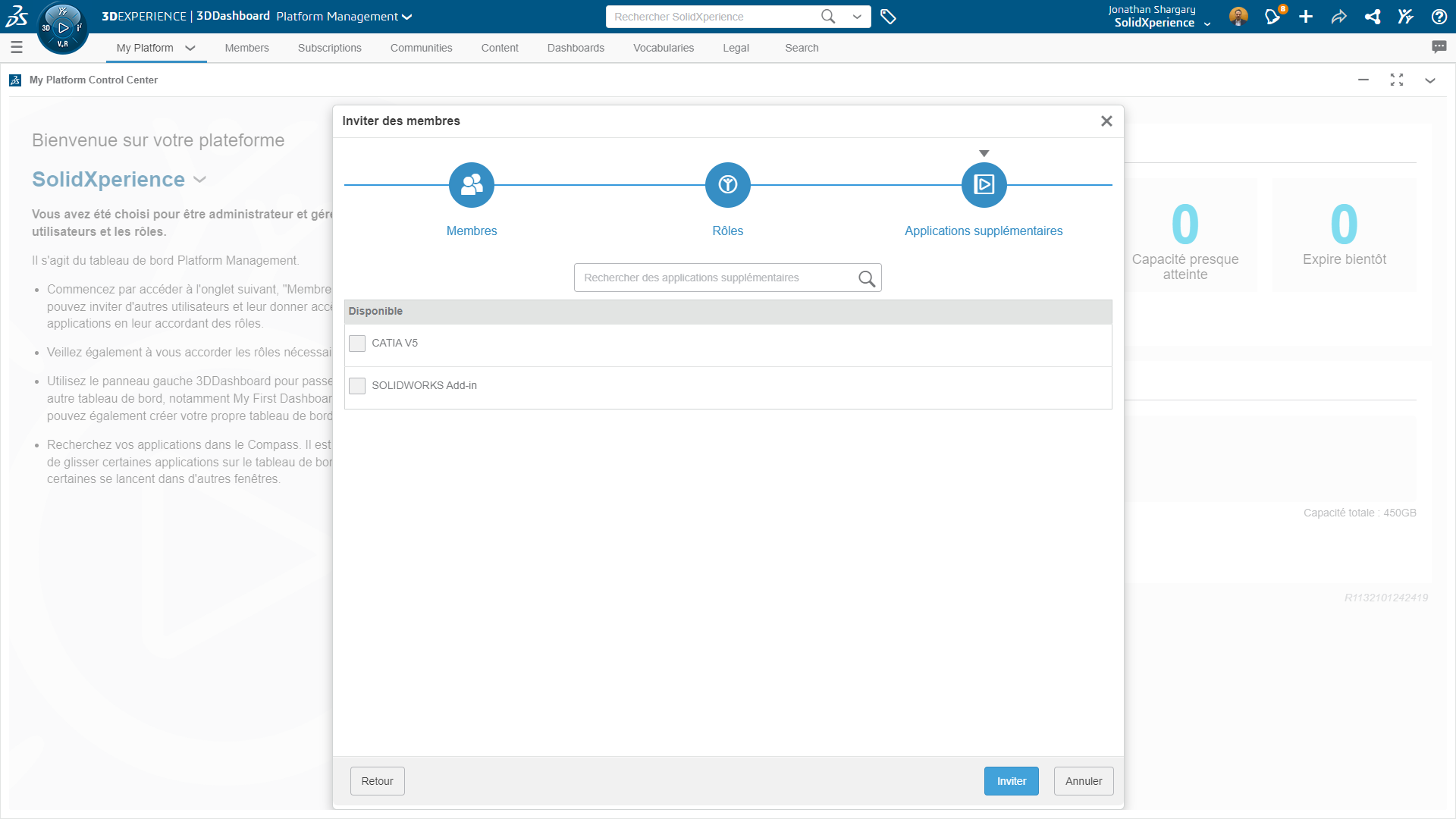

Commencez avec les fonctionnalités d’IA intégrées disponibles et les capacités actuelles des Compagnons Virtuels, accessibles dans le volet de tâches « AI Lab » directement dans SOLIDWORKS Design. L’accès aux Compagnons Virtuels nécessite l’activation des Services Cloud, qui est incluse dans chaque licence de SOLIDWORKS Design.

L’IA est-elle capable de corriger automatiquement les modèles CAO ?

Oui, l’IA peut identifier les problèmes, expliquer les erreurs et suggérer des corrections, mais les ingénieurs restent responsables de l’approbation des modifications.

L’IA va-t-elle remplacer les concepteurs et les ingénieurs CAO ?

Non. L’IA aide à automatiser les tâches répétitives et à révéler des connaissances, mais les ingénieurs restent responsables de l’intention de conception, de la validation et de la prise de décision.

Vous souhaitez aller plus loin ?

- Découvrez davantage de conseils et tutoriels sur notre chaîne YouTube.

- Explorez les meilleures pratiques avec nos experts.

- Ou contactez votre équipe Solidxperts nous sommes là pour vous aider à tirer le meilleur parti de votre plateforme.

Vous avez des questions ? Besoin d’aide ? Demandez à l’un de nos experts.

Que vous soyez prêt à commencer ou que vous ayez quelques questions supplémentaires, vous pouvez nous contacter sans frais :